智东西6月13日消息,今天,美国3D计算机视觉创企Luma AI发布了一个名为Dream Machine的AI模型。这一模型具备强大的文生视频和图生视频功能,画面极为逼真,人物表情丰富,2分钟内就能完成5秒视频生成。Dream Machine最让人眼前一亮的特点是,它所生成的视频中包含极为真实的摄像机运动轨迹、自然的光影变化以及较好的一致性。下方视频是Luma AI放出的官方demo之一,内容是第一视角的废墟探险画面。随着探险者进入室内,画面的曝光程度出现了变化,探险者的手电光线也有自然的晃动,十分符合真实情况。摄像机的视角就好像废墟探险者常常佩戴使用的运动相机拍摄的一样,让人有身临其境的体验。

此外,与Sora等其它大多数视频生成模型不同,Dream Machine目前可在Luma AI官网直接免费使用,免费用户有每月30次的生成额度,这已经可以完美满足大部分人的非商用需求了。不过刚刚发布时,有大量用户涌入Luma官网,争相体验Dream Machine的视频生成效果。这导致Luma官网服务器一度宕机,几乎无法正常生成视频,直到目前才有所缓解。参与Dream Machine早期beta测试的人员称赞该系统能够忠实地渲染指定的对象、角色、动作和环境,同时保持流畅的运动和连贯的叙事。

▲官网公告:生成需要120秒。然而由于需求激增,您的请求可能需要排队。

Luma AI成立于2021年,总部位于旧金山。Luma此前是一家专注于3D内容生成的计算机视觉初创公司,已经完成两轮融资,曾获英伟达和硅谷顶级风投公司Andreessen Horowitz(简称a16z)投资,投后估值约2-3亿美元。Luma AI之前的明星产品之一是文本转3D模型Genie 1.0,它能在10秒内根据文本内容完成多种格式的3D建模。

Dream Machine一经发布就瞬间爆火,大排长龙,生成一次视频大约要排队15分钟。不过在热度稍减后,智东西终于有机会对Dream Machine展开大量测试,获取第一手的体验报告。

Dream Machine的使用体验极为便捷,在简单的注册流程后,用户便可以直接进入视频生成界面。Dream Machine允许两种类型的提示词:图片+文字以及纯文字提示词。若勾选输入框右下角的“Enhance prompt”选项,还能自动优化用户输入的提示词并实现更好的生成效果。官网的输入框下方提供了许多示例提示词,于是智东西首先使用了这些提示词进行测试,我们使用的其中一条提示词是“Low-angle shot of a majestic tiger prowling through a snowy landscape, leaving paw prints on the white blanket (低角度拍摄一只威严的老虎在雪地中潜行,留下爪印在白色的雪毯上)”。Dream Machine的视频生成速度确实没有夸大,除去排队的时间,这段5秒钟的视频在不到2分钟的时间里就完成了,但效果却不尽如人意。

在Dream Machine生成的视频中,提示词里关于拍摄角度的指令完全被忽略了,视频采用的是鸟瞰而非低角度拍摄。同时,老虎在雪地上的脚印也几乎不可见。此外,老虎的跑动方式和尾巴的甩动都不太符合物理规律。老虎身上的花纹随着镜头拉远不断变化,一致性也比较一般。Dream Machine这是要翻车的节奏?为进一步确认Dream Machine的实际生成效果,智东西使用Luma AI官方账号转发的一位专业创作者的提示词进行二次测试。这则提示词是图片+文字的形式,文字内容是“Girl gazes with wonder(女孩带着惊奇的目光凝视)”,而输入的图片则是荷兰画家约翰内斯·维米尔的名画《戴珍珠耳环的少女》。我们还特别生成了两个版本,一个勾选了“Enhance prompt”,另一个没有勾选。 ▲未勾选Enhance prompt功能

▲未勾选Enhance prompt功能

本次生成的速度依旧很快。生成结果表明,是否勾选Enhance prompt功能对Dream Machine的生成效果有很大的影响。在未勾选这一功能的第一个生成结果中,人物几乎没有任何变化,视频仅仅是将镜头拉近了。而在勾选了这一功能的第二个生成结果中,画中的人物才真正动起来了。随着视频里人物的移动,她面部和头巾上的光线和阴影都有比较自然的变化。而服饰上的纹路在人物移动的过程中基本保持了一致。然而这一生成结果也并非毫无破绽。视频中人物的面部在前几帧过后便出现了变化,五官和妆容都与画中人物有所差异。虽然模型知道人物应该佩戴对称的一副耳环,但由模型生成的那一侧耳环看上去并不像是珍珠耳环,没有原画中珍珠的光泽和质感,形状和颜色也略有区别。

▲Luma AI官方转发的视频

与Luma AI官方转发的视频相比,尽管智东西使用了相同的提示词,但我们测试中生成的这一条视频中人物的表情和神态并不像官方视频中那般丰富。不过总体来看,这两个视频生成的效果都是比较好的,基本还原了原画中人物的着装,光影和移动也比较自然流畅,仅仅在一致性上有一些小问题。作为目前视频生成模型中的顶流,Sora在Dream Machine发布后便迅速被各路网友拉来和Dream Machine比较。智东西使用了一则OpenAI官方放出的Sora Demo中的提示词,对两个模型的表现进行了相对严格的平行对比。

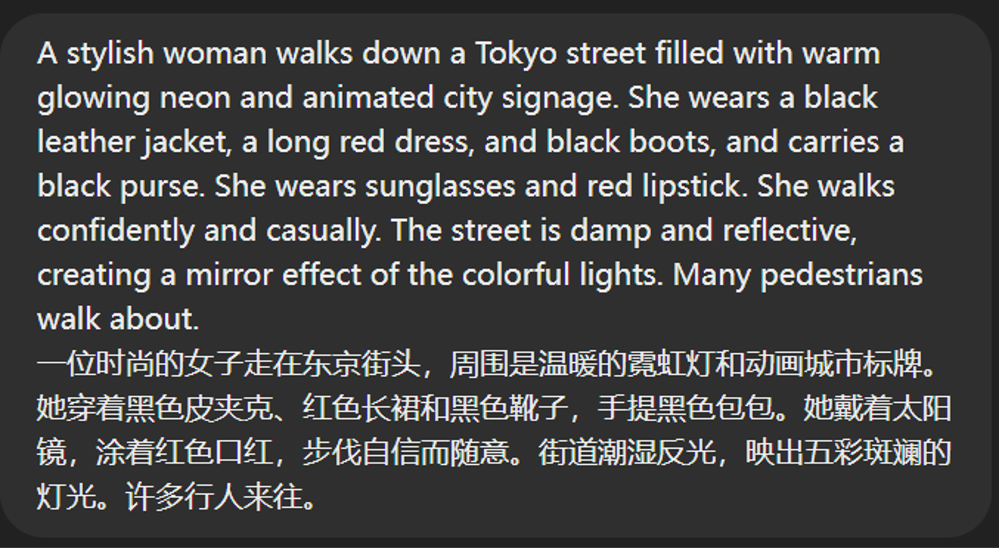

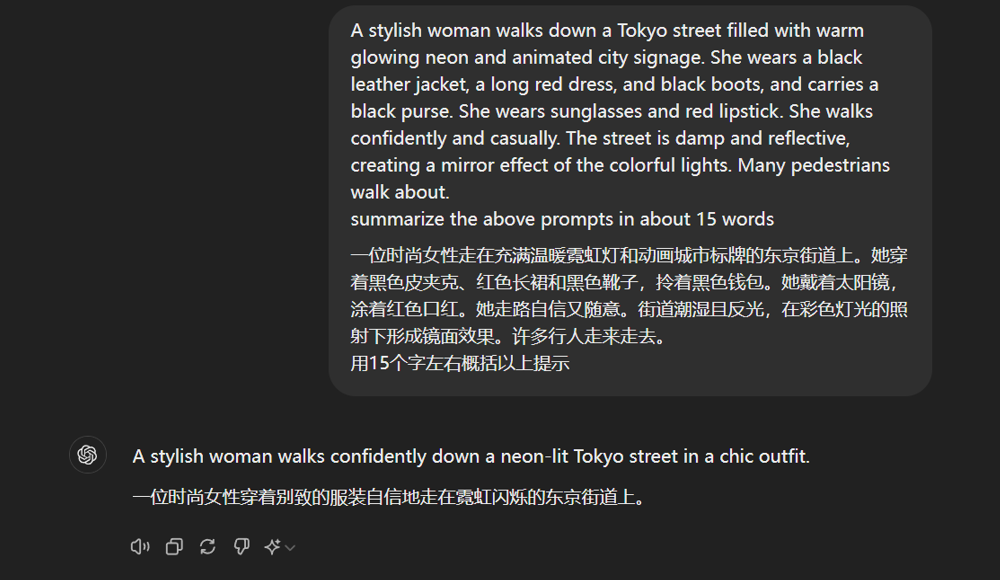

▲本次生成中使用的提示词

▲Dream Machine生成结果

▲Sora官方demo

对比之下,Dream Machine生成的效果和Sora还存在一定差距。画面中的主要人物表情神态都不太自然,“AI味儿”比较重。人物的右手形态畸形,而左腿在行走的过程中还出现了类似“穿模”的问题。而模型生成画面背景中的人物时也出现了幻觉,背景中的有一位骑着自行车的男士在移动过程中变为了几位并排行走的人。Dream Machine唯一比较可圈可点是在人物走过路面积水时,生成了比较真实的倒影和涟漪,且生成的视频速度比较符合真实情况。不过,拿OpenAI发布的官方demo和Dream Machine的用户实测效果比较确实不太公平。AI公司们一直有美化demo效果的“传统”,模型的实际生成效果和demo总是存在一定差距的。作为免费模型,Dream Machine用户实测时大量的生成需求可能会对原本就不富余的算力带来冲击,影响实际生成效果。此外,超长的提示词可能也会给模型带来一定压力。智东西用ChatGPT总结了这一demo的提示词,再给Dream Machine一次机会。

▲精简后的提示词

▲勾选Enhance prompt的生成结果

▲未勾选Enhance prompt的生成结果

在精简提示词后,Dream Machine的生成效果确实得到了一定改进。勾选Enhance prompt的生成结果中,人物面部的光线随着路边霓虹灯的变化而变化,而她的神态也基本符合提示词中的描述,视频运镜颇有赛博朋克风的大片的感觉。美中不足的是背景中的人物仍然存在一些形变,霓虹灯牌上的文字也在人物经过时产生了一些变化。未勾选Enhance prompt的生成结果在真实性上竟然有一定程度的提高,但在镜头晃动时面部的一致性受到轻微的影响。综合以上测试结果,Dream Machine作为一款免费的视频生成工具还是可圈可点的。它在生成速度上无可挑剔,支持多模态输入,还能自动优化输入的提示词。在多次测试后我们发现,使用Dream Machine生成视频时,使用图像+文字的提示词往往比使用纯文字提示词的效果更好,在生成结果的真实性和对提示词的遵循程度上都会有明显的提升。但在处理较长的提示词时,这台“造梦机”也会面临卡壳的情况。我们在测试时,长提示词的等待时间要显著长于普通长度的提示词,最终的生成效果也会打折扣。若Dream Machine不受公测期间可能的算力短缺问题,或许它真的能实现与Luma AI官方demo中类似的效果。

有不少网友和专业创作者也上手测试了Dream Machine,并将它们与其它视频生成模型进行比较。下方这位网友将Dream Machine与Runway和Pika这两个视频生成模型进行对比。这位网友认为,Luma AI的Dream Machine在大多数镜头中完胜。

下图中的网友则认为Dream Machine在运动和一致性上表现很好,并且让普通消费者也能体验到Sora般的质量。这位网友拼接了多个Dream Machine生成的视频并配上音乐,最终做出了一条3分多钟的AI生成MV。

在专业创作者的调教下,Dream Machine确实发挥出了更好的水平。这一视频中的画面梦幻而又怪诞,与音乐的风格十分契合。不少网友大开脑洞,找到了Luma AI官方也没想到的使用场景。有位网友将表情包输入Dream Machine然后生成视频。这一创意也获得Luma AI官方转发,称Dream Machine摇身一变成为名副其实的Meme Machine(表情包制造机)。还有一位网友将自己一家人30年前在冲绳旅行时的照片发给Dream Machine,而生成的视频让这张30年前的照片也有了如今动态照片般的效果。Dream Machine还能生成多种风格的视频。有一位网友将自己孩子最喜欢的毛绒玩具变成了动画,还有一位专业创作者利用Dream Machine创作了一条一分钟的动画短片。在上方的视频中,Dream Machine的一致性再次得到了验证,视频里的卡通人物主角在不同的场景下外貌都基本一致。此外,视频中人物表情生动,富有感染力,画面中的其它元素相对稳定,各种动作和人物与场景的互动也基本符合物理规律。来自美国科技媒体Tom’s Guide的记者Dave LeClair在观看了下方这则demo后称,Luma AI发布的视频示例中的摄像机运动看起来非常逼真。如果不告诉他这些视频是Dream Machine制作的,他会毫不犹豫地相信视频是用高端摄像机在轨道上拍摄的。不过美国媒体VentureBeat也指出,作为免费的视频生成工具,Dream Machine将不可避免地面临滥用的风险。Luma AI在其网站上向所有人免费提供Dream Machine的使用权,并计划发布API接口和主流创作软件的插件。这种开放的方式确实可以让Luma AI抢占先机,建立充满活力的创造者和开发者社区,但相关的治理框架或许无法赶上科技发展的速度。在创新和责任之间找到适当的平衡将成为整个行业和社会面临的重要挑战。

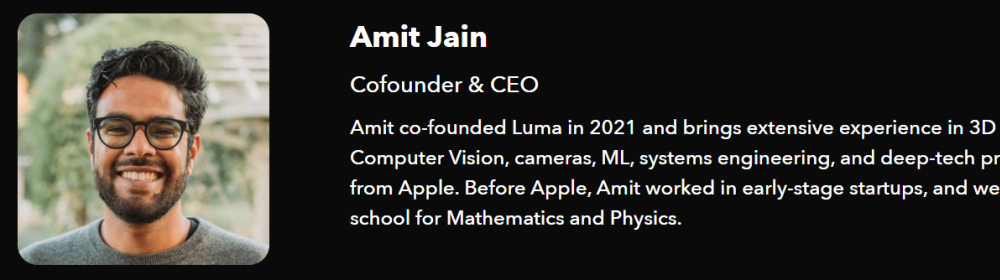

Luma AI在发布Dream Machine之前并不是一家知名的AI企业。它成立于2021年,总部位于加利福尼亚州旧金山。Luma先前专注于开发AI技术,以3D格式捕捉和体验现实世界。在Dream Machine之前,Luma的主打产品是Luma AI移动应用程序,它允许用户使用手机相机捕捉物体和场景的空间3D模型。该应用程序使用神经渲染技术,如神经辐射场(NeRF),生成具有照片级质量的高细节3D模型。3D捕捉可以作为3D视频分享,导出为3D对象,或嵌入到网站和应用程序中。Luma AI服务于需要高级3D和视觉技术的行业,如电子商务、虚拟现实和游戏。Luma AI是一个小团队,官网上的信息显示目前在Luma AI任职的员工仅有不到40人。根据媒体Z Potentials的独家专访内容,Luma的创始人兼首席执行官Amit Jain经验丰富,曾在苹果公司参与Vision Pro的开发工作,在 3D计算机视觉、相机硬件、机器学习、系统工程和深度技术产品方面积累了丰富的经验。

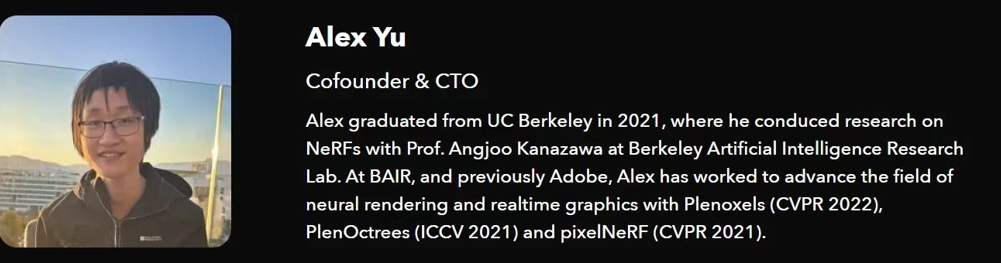

就如许多其它AI公司一样,Luma AI的团队里也有许多华人。Luma的另一位创始人兼 CTO余思贤大学就读于加州大学伯克利分校,跟随一位来自日本的 Angjoo Kanazawa 教授做早期 NeRF 神经渲染研究,同时也在 Google 和 Adobe 实习过,2021年毕业之后,他遇到了Luma AI的另一位创始人Amit Jain并决定一同创业,因此拒绝了斯坦福大学、麻省理工学院等大学的博士Offer。

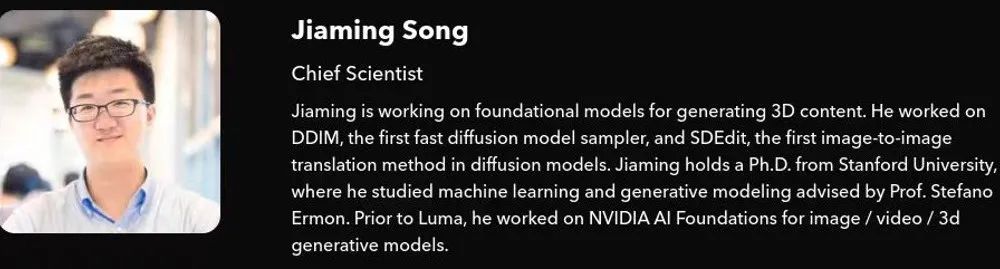

Luma AI的首席科学家宋佳铭毕业于清华大学,大二时便开始研究机器学习。他后来前往斯坦福大学深造,毕业后还拒绝了清华姚班的教职 Offer,加入英伟达。他的研究成果之一DDIM (denoising diffusion implicit models) 算法显着提升了扩散模型的生成速度,这一算法在Stable Diffusion 和 DALL·E 2 中都得到了应用。

到目前为止,Luma AI已经筹集了总计6730万美元的风险投资,其中包括他们在2024年初的4300万美元B轮融资。主要投资者包括英伟达、Andreessen Horowitz(简称a16z)和Amplify Partners。Luma AI B轮投后估值约为2-3亿美元。

近一年来,AI视频生成领域的热度持续攀升,多家AI公司推出了新的视频生成模型,引发了行业内的激烈竞争。较早进入文生视频领域的Runway目前已经推出了两代视频生成模型,还雄心勃勃地勾勒出了“通用世界模型(General World Model)”的宏大愿景。而华人团队背景的Pika已经进行了三轮融资,筹款5500万美元。OpenAI更是用Sora这一划时代的产品,彻底引爆了这条赛道。Luma AI从3D建模转到视频生成赛道背后,除了文生视频领域本身的热度外,也和他们之前的背景有关。要生成逼真自然的视频画面,对3D物体和空间的理解是必不可少的,而Luma在这方面已经有一定的积累,并获得了投资人的认可。或许Luma AI的Dream Machine能给这一赛道带来新的惊喜。(本文系网易新闻•网易号特色内容激励计划签约账号【智东西】原创内容,未经账号授权,禁止随意转载。

▲未勾选Enhance prompt功能